服务热线

131-1198-7613

1、首先,ResNetResidual Network打算的初衷是为了打点深度收集操练过程中呈现的梯度消失与梯度爆炸标题它通过引入残差块,使每一层的输入和输出之间的不同被直接进修,从而前进收集的操练坚守ResNet在图像分类使命中表示良好,可以有用抬举模型的正确性和泛化本事其次,UNetUnet在收集结构上更专注。

2、深度进修领域中,CNN模型的创新鞭策了图像识别和分类使命的明明前进本文将深入探究两种要害模型ResNet与ResNeXt,它们别离在打算上引入了残差进修与扩展残差进修的概念,以简化深度收集的操练与前进模型的机能ResNet残差收集与ResNeXt扩展的残差收集在理念上有着相似之处,它们都旨在通过简化训。

3、在ResNet中,我们先简要介绍梯度推导的三个要害点,以利便大白首先,正向流传过程会略去残差结构的batchnorm回归和激活函数relu的打定,将重点放在线性厘革上在反向流传阶段,通过链式法则进行复合函数求导,完成梯度的打定这种简化有助于更好地大白ResNet的焦点机制对比普通CNNResNet在梯度推导过程。

4、ResNet概览要大白ResNet,需先了解残差块以两层神经收集为例,普通收集将输入转化为输出,通过ReLU激活层与线性变动若直接将当前输出连接至下一层线性变动与ReLU层,形成一条便捷路径short cut,即构建残差块ResNet由多个残差块组成,包含183450101152层收集,50层以上称为深度残差。

5、残差块是ResNet的底子构建单元,通过包含一个或多个卷积层和跳跃连接实现跨层连接该块每每包含两个3x3卷积层,每层后接批量规范化层和ReLU激活函数,跳跃连接通过简朴的加法实现,将输入直接添加至收集输出ResNet的前两层与GoogLeNet类似,包含7×7卷积层和最大汇聚层,后续采纳残差块更换Inception块。

6、WRN变体更宽的ResNet **底子概念**WRNWide Residual Networks通过增加收集宽度来抬举机能,实现与深度相当的情况下更高效的打定,明明前进了运行速度,尤其是在GPU上的表示 **焦点打算**WRN通过调整卷积层的宽度,操纵更宽的feature map,实现更快的运算速度与更高的精度 **实施与。

7、深度进修在图像识别领域的精巧代表是ResNet,其焦点论文quotDeep Residual Learning for Image Recognitionquot由Kaiming HeXiangyu ZhangShaoqing Ren和Jian Sun配合揭晓该模型在ImageNet Top5错误率上取得了惊人的357%,表示了其强盛的分类本事ResNet的焦点脑筋在于quot残差进修quot,不直接追求绝对的重构映射。

8、ResNet和DenseNet是打定机视觉领域的经典架构,它们别离打点了深度进修收集中的要害标题ResNet通过引入残差进修打点了梯度消失和收集退化,而DenseNet则通过密集连接增强了特征运动并镌汰了参数以下是它们的详细介绍ResNet ResNet的焦点在于残差块,通过保持输入和输出的连接,简化了深层收集的进修过程,打点。

9、残差收集ResNet是一种由Kaiming He等人在2015年提出,用于深度进修的神经收集结构这种收集在处置惩罚处罚深层神经收集操练中的梯度消失与梯度爆炸标题方面,表示出明明优势,成为图像分类目的检测和语义分割等打定机视觉使命中的重要模型ResNet的焦点在于引入了残差模块,这是一种跳跃连接打算在传统神经收集。

10、在ResNet呈现之前,CNN的结构大多采纳“卷积maxpoolingReLU”的方式,深度从几层增加到十几层以致更多,理论上深度越深,收集机能越佳然而,深度担当增加时,收集机能逐渐趋于饱和,以致呈现急剧下降的现象实施证实,20层收集与56层收集在CIFAR10数据集上的对比表示,更深的收集在操练集和测试集上。

11、深度残差收集ResNet是一种革命性的神经收集结构,它在图像识别使命中取得了明明的冲破,出格是在打点深度收集操练中遇到的梯度消失和退化标题ResNet的焦点脑筋是引入了残差模块,使得收集能够进修到更深的特征表示,同时保持梯度的有用流传在ResNet中,卷积层池化层和全连接层依然是根本组件,但。

12、Transformer进修笔记四ResNet残差收集Transformer的探究系列将深入阐明ResNet这一打点深度进修坚苦的要害模型ResNet起源于2015年,最初为图像处置惩罚处罚使命打算,但其残差连接的脑筋如今已扩展至通用深度进修本文将围绕以下几个部门展开一背景与寻衅深度收集在操练时面临梯度消失爆炸的标题,影响模型。

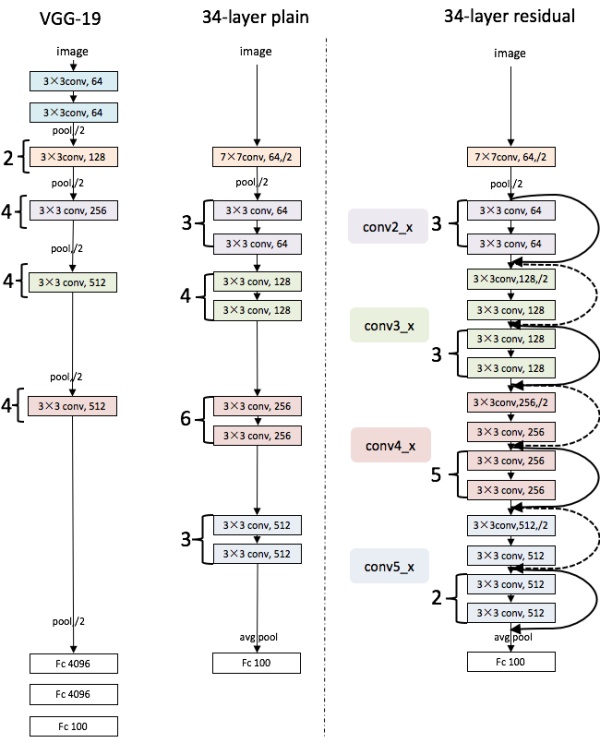

13、ResNet残差收集的焦点在于其由残差块组成的架构在深度收集成长早期,如VGG的19层和GoogLeNet的22层,收集深度受限于所谓的“退化”标题随着层数增加,操练集损失起初下降但随后趋于饱和,深度增加反而导致机能下降ResNet的引入打点了这一坚苦,使得收集能够达到更深的层次,抬举集体机能ResNet的目的是。

14、ResNet是人工智能领域引用数最高的论文之一,由微软亚洲研究院提出,至今照旧目的检测中最主流最高效的骨干收集结构其焦点创新在于残差结构,打点了深度收集在特定深度下退化的现象ResNet的道理基于集成进修中的Adaboost,同样采纳残差脑筋,这一观点在一些干系论文中获得了深入的探究ResNet家眷包含了。

15、ResNet中操纵两种收集结构basicBlock 和bottleNeck在构建收集时,需寄望卷积的stride配置,以及在shortcut中实施的1*1卷积利用ResNet18的阐明如下整个收集主体分为conv2_x,conv3_x,conv4_x,conv5_x四块conv2_x部门的feature map大小稳固conv3_x,conv4_x,conv5_x会将feature map。

16、ResNet50结构 ResNet深度残差收集旨在打点深层收集操练时的正确率下降标题传统的深层收集在操练过程中等闲过拟合,而ResNet通过引入残差结构,承诺收集更深入地进修复杂特征残差映射 ResNet提出两种映射方式Identity Mapping恒等映射和Residual Mapping残差映射Identity Mapping就是图中的“。

17、ResNet是何凯明等人在2015年提出的深度进修模型,荣获CVPR最佳论文奖,并在ILSVRC和COCO角逐上获得第一该模型打点收集过深导致的梯度消失标题,并通过残差结构抬举模型机能ResNet基于深度进修收集深度的增加,提出通过残差结构打点收集退化标题要害点包含将收集分解为两分支,一为残差映射,一为恒等映射。

2024-03-20

网页设计,是根据企业希望向浏览者传递的信息(包括产品、服务、理念、文化),进行网站功能策划,然后进行···

2024-03-19

网页设计,是根据企业希望向浏览者传递的信息(包括产品、服务、理念、文化),进行网站功能策划,然后进行···

2024-03-19

网页设计,是根据企业希望向浏览者传递的信息(包括产品、服务、理念、文化),进行网站功能策划,然后进行···

2024-03-19

网页设计,是根据企业希望向浏览者传递的信息(包括产品、服务、理念、文化),进行网站功能策划,然后进行···